Après un long week-end de compétition au championnat de France de roller indoor, j’ai profité de la semaine de récupération qui suivait pour commencer à réorganiser mon réseau interne. Une idée que j’avais en tête depuis un moment déjà.

Au niveau de l’existant, je partais donc d’un réseau composé d’un modem-routeur OVH, d’un routeur personnel et de périphériques clients, parmi lesquelles serveur, NAS, téléphone ou encore PC. Mon objectif principal était d’arriver à me passer du matériel du FAI, afin d’exploiter mon routeur au maximum de ses capacités. Il faut préciser que le modem-routeur fournit par OVH, un technicolor TG788v2, n’est pas fantastique. Il fonctionne bien, mais l’interface n’est pas des plus intuitives, l’assignation d’IP fixe côté DHCP est une plaie et je me retrouvais avec un double NAT pas des plus pratiques.

En remplacement du routeur, j’ai donc fait l’acquisition d’un petit modem compatible avec les caractéristiques de ma ligne OVH, à savoir un DM200 de chez Netgear. J’ai configuré ce dernier en mode bridge, pour confier la gestion du réseau à mon routeur. En parallèle, j’ai migré le-dit routeur (un R7000) vers le firmware alternatif AdvancedTomato pour bénéficier de nombreuses nouvelles possibilités de configuration. Il aura fallu quelques heures pour trouver une première configuration satisfaisante, notamment du côté de la redirection de ports qui ne voulait pas fonctionner à cause d’un paramètre particulier de la configuration WAN.

Par la suite, j’ai cherché à configurer le serveur OpenVPN disponible avec Tomato. Après plusieurs essais, j’ai enfin réussi à me connecter au VPN depuis mon téléphone et à écouter avec satisfaction un fichier de musique en provenance de mon NAS. Les fichiers Flac ont malheureusement du mal à passer, la faute au peu de débit montant des connexions internet traditionnelles. Cela permettra au moins d’éviter l’explosion de la consommation de données du forfait mobile. Restait encore le problème de la ligne téléphonique. Après ajout d’un petit boîtier Cisco nommé SPA112 et connexion d’un téléphone sur l’un de ses ports RJ11, le problème était résolu.

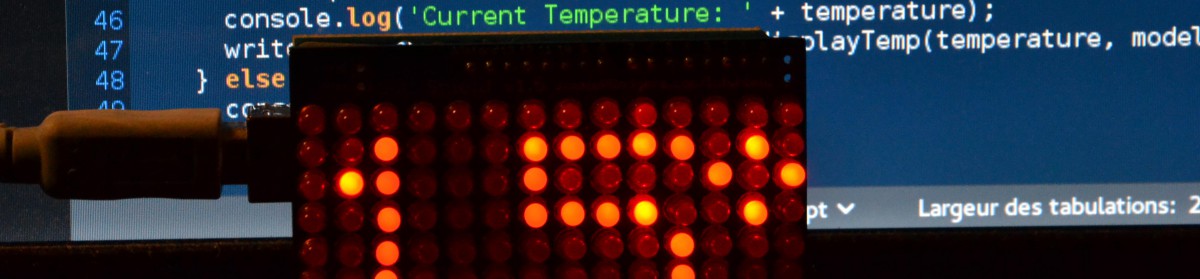

Tous ces changements m’ont obligé de ressortir un switch inutilisé pour disposer de plus de ports, pouvoir connecter un Raspberry Pi, et commencer la suite des opérations à savoir : étudier les possibilités offertes par Ansible et par LXC dans leur domaine respectif. Le WakeOnLan figure lui aussi en bonne position sur la liste des choses à tester pour une éventuelle intégration dans l’architecture globale du réseau.

En bref, de nombreuses idées, de nombreuses pistes à explorer et une structure de réseau à valider par l’usage quotidien des prochaines semaines !